В мае 2020 года Дип Гангули, директор по исследованию в Стэнфордском институте искусственного интеллекта, впервые осознал, насколько стремительно развивается ИИ. Модель GPT-3, представленная OpenAI, была в десять раз мощнее предыдущих и обещала кардинальные изменения в обществе. Понимая важность контроля над такой технологией, Гангули присоединился к стартапу Anthropic, основанному бывшими сотрудниками OpenAI, обеспокоенными безопасностью ИИ.

Команда под руководством Гангули занимается исследованием общественных последствий ИИ. Всего в ней девять человек, и они изучают влияние ИИ на экономику, политику и социальные процессы, а также разрабатывают способы предотвращения рисков, связанных с дискриминацией и манипуляциями.

Работа команды включает в себя анализ того, как пользователи взаимодействуют с чат-ботом Claude, созданным Anthropic. Для этого был разработан инструмент Clio, который отслеживает темы и типы запросов пользователей. Это помогает выявлять потенциально опасные или нежелательные сценарии использования, например, создание неподобающего контента или спам.

Команда работает в тесном сотрудничестве с другими подразделениями компании, поддерживает открытый диалог и стремится к максимальной прозрачности. Несмотря на коммерческую ориентацию Anthropic, руководители поддерживают исследования и публикации, даже если они выявляют недостатки в технологиях компании.

Участники команды отмечают, что их объединяет не только профессиональная задача, но и общие ценности, стремление создавать безопасный ИИ, который принесет пользу всему обществу. Они понимают, что влияние ИИ выходит далеко за пределы технологий — меняются способы общения, принятия решений и даже эмоциональные связи людей.

Особое внимание уделяется эмоциональному интеллекту ИИ и его влиянию на пользователей, включая феномен «психоза ИИ», когда люди могут чрезмерно привязываться к чат-ботам и терять связь с реальностью.

В условиях быстрого роста компании и масштабного внедрения ИИ команда сталкивается с ограничениями по времени и ресурсам, однако стремится расширять свои исследования и усиливать влияние на конечные продукты.

Их миссия — не просто создавать технологии, а понимать и управлять их последствиями для общества, чтобы ИИ стал силой во благо, а не угрозой.

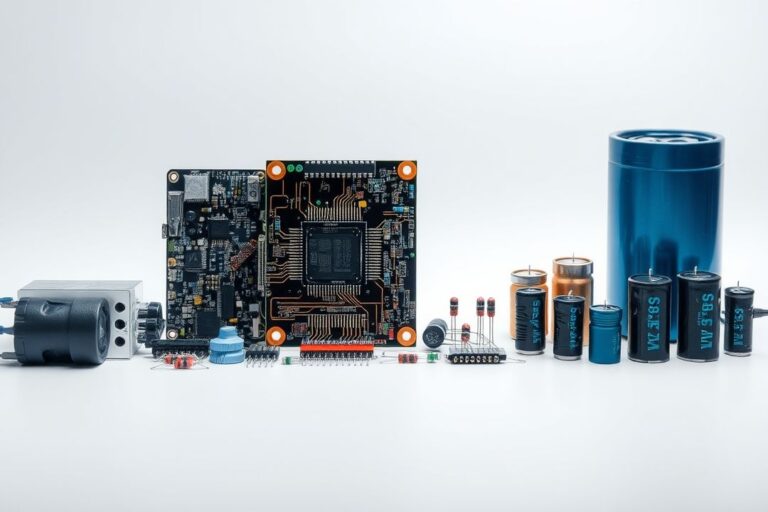

Изображение команды Anthropic, занимающейся вопросами общественных последствий ИИ, символизирует важность совместной работы и ответственности за будущее технологий.